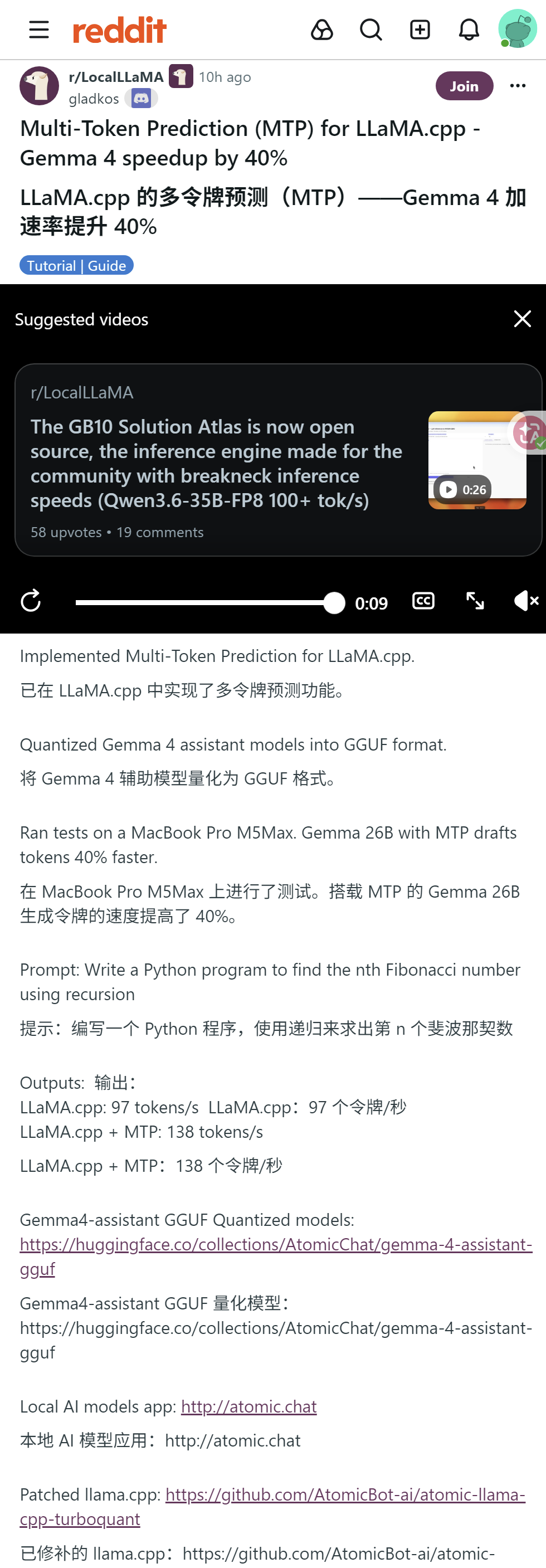

LLaMA.cpp实现MTP功能,Gemma4令牌生成提速40%

2026-05-08 19:41:41

27次阅读

2个评论

Reddit用户发帖称在LLaMA.cpp中实现多令牌预测(MTP),将Gemma4量化为GGUF格式,M5Max测试显示Gemma26B令牌生成提速40%,附相关资源;网友关注生成质量、工具兼容性,还有人分享其他模型MTP测试情况。

0

0

2026-05-08 19:42:13

回复 |

引用

2026-05-08 19:42:42

回复 |

引用

共2条

1

相关帖子

- llama.cpp MTP支持进入beta 本地大模型推理大幅提速

- 12GB显存跑Qwen3.6 35B:80tok/s+128K上下文!llama.cpp MTP攻略

- 调整Gemma 4视觉令牌参数可大幅提升其视觉识别能力

- Gemma4与Qwen3.6 KV缓存量化KL散度测试及相关讨论

- 本地跑Qwen3.6/Gemma4体验佳?网友实测各模型优劣引热议

- gemma-4-31B-it-DFlash模型已正式发布

- Qwen3.6-27B搭MTP借未合入PR实现2.5倍吞吐量提升

- Gemma 4 GGUF聊天模板修复,无需重下数十GB权重

- 网友晒自调Gemma 4机器人个性,实用提示词引热议

- GPT-Image-2新增自审迭代功能,生成效果引网友热议