Qwen推出FlashQLA高性能线性注意力内核 仅支持SM90及以上GPU

2026-04-30 17:46:27

32次阅读

3个评论

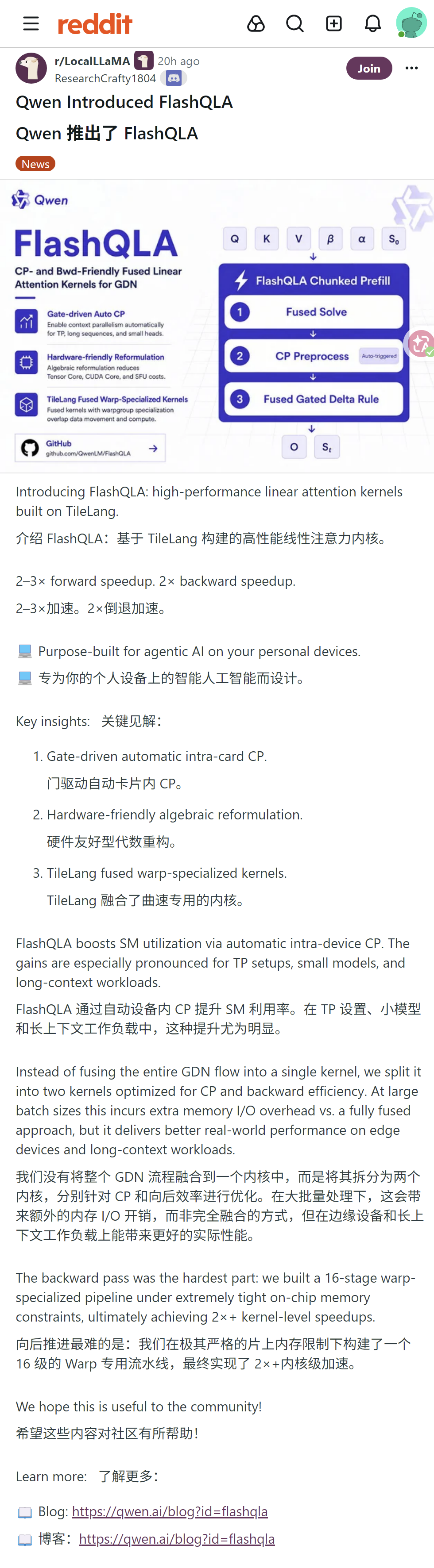

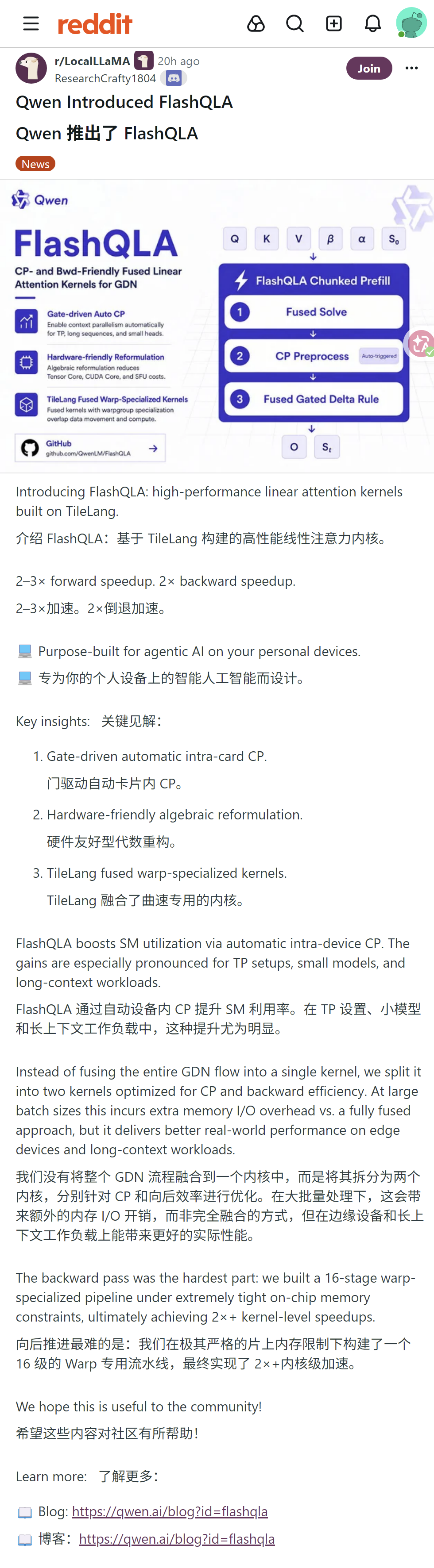

Qwen推出基于TileLang构建的高性能线性注意力内核FlashQLA,前向提速2-3倍、反向提速2倍,专为个人设备端智能体AI设计,仅支持SM90及以上GPU,网友围绕缩写歧义、显卡适配、工具适配等展开讨论。

0

0

2026-04-30 17:47:00

回复 |

引用

2026-04-30 17:47:29

回复 |

引用

2026-04-30 17:47:58

回复 |

引用

共3条

1